Как устроен ЗИП в дата-центрах, и что мы делаем, когда горит материнка

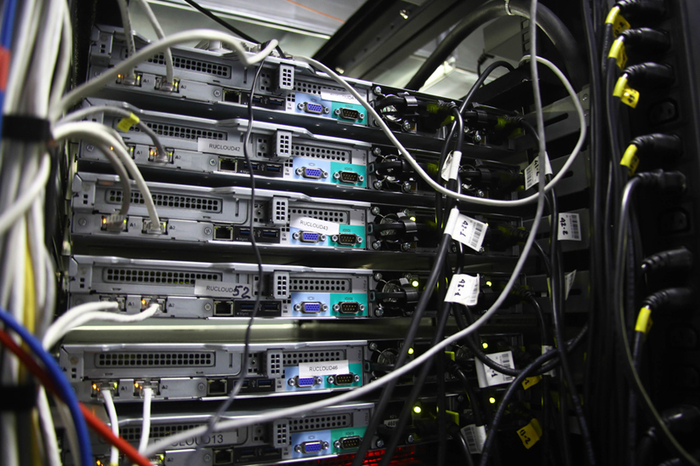

Примерно вот такой набор должен быть всегда под рукой. Обычно там лежат расходники (SSD- и HDD-диски, планки оперативной памяти, RAID-контроллеры, батарейки к ним, блоки питания):

Это то, что чаще всего вылетает в сервере, и то, что дублировано, то есть сервак продолжает работать с деградацией производительности. Также дублированы питание и много чего ещё, но питание можно менять и не так быстро.

У нас в каждом дата-центре по миру — корпоративное железо. У него гарантия — Next Business Day от поставщика или производителя. Это значит, что если что-то ломается, то в течение следующего рабочего дня привозят замену. Но для жёсткого диска это долго: да, все массивы — RAID 10, но надо менять диск сразу, а не ждать сутки.

Если сервер падает в пятницу вечером, то следующий рабочий день наступает только во вторник (пока заявка, пока логистика). Для критической инфраструктуры ждать три-четыре дня просто непозволительно.

ЗИП — это железо, которое просто простаивает. И вот тут включается ещё одна важная особенность и тарифов, и политики выбора железа: оно должно быть гомогенным. Если у нас в стойках — зоопарк, то и компонентов надо держать больше. Мы стараемся закупать одинаковые платформы большими партиями. В качестве бонуса — не только цена и одинаковый софт (а это дальше влияет и на тарифы), но и один комплект ЗИП.

Замену делает синее тело — аватар, которому это поручается. Специфика иностранных площадок в том, что наших инженеров там физически нет. Мы полагаемся на услугу «Удалённые руки». Это не когда нет ручек и нет мультиков, а когда местные инженеры дата-центра ходят к стойкам по нашим тикетам: нажимают кнопки, меняют диски и коммутируют провода.

Эта система стабильна, но не без сюрпризов.

Ситуация на рынке сейчас сложная: спрос на зарубежные мощности огромный, а логистика из Китая и Европы хромает. Партии оборудования, которые раньше ехали месяц, теперь могут добираться полгода. В Амстердаме у нас полный sold out: свободных серверов нет, ждём поставку только после Нового года. И именно в этот момент на одной из платформ Хуавея умирает сервер.

Само по себе это событие — из ряда вон. Обычно электроника либо сразу ломается (заводской брак), либо работает годами. Этот сервер отпахал почти год, гарантия уже подходила к концу. Сначала мы грешили на привычные вещи: может, RAID-контроллер сбоит? Может, процесс завис?

Но диагностика показала, что проблема — в материнской плате.

Почему это страшно? Потому что материнская плата — это, по сути, и есть сервер. Это шасси, к которому прикручена плата. Держать в ЗИПе запасные материнки — значит, иметь на складе пустые дорогостоящие серверы, которые просто пылятся. Обычно в ЗИПе лежат диски (они часто летят), блоки питания (бывает), даже контроллеры. Оперативку держать почти нет смысла: если планка сгорела, то сервер просто увидит меньше памяти, но продолжит работать. А вот материнка... За 10 лет работы мы ни разу не видели, чтобы качественная серверная мать умирала своей смертью посреди срока эксплуатации.

Но она умерла. И выяснилось, что в нашем ЗИПе её нет (что логично), но её нет даже у самого Хуавея на местных складах в Европе!

Такую крупную запчасть вендор пообещал доставить только через неделю плюс время на авиадоставку.

Теперь — как вообще всё это происходило. Тут есть вторая особенность — медленная поддержка. Это менталитет Европы. Пример: сервер упал в субботу вечером — по телеметрии просто выключился. Мы пишем тикет местным, чтобы сходили и нажали на питание. Инженер идёт целый час, нажимает. Появляется ошибка по питанию, но физически на блоках питания горят зелёные лампочки. Мы просим поменять блоки местами, потом попробовать запуститься на одном блоке (сервер умеет работать на одном, второй — резервный).

Инженер делает это крайне медленно, весь рабочий день, часами переписываясь с нами.

Меняется текст ошибки: теперь система жалуется на процессор. Конкретно — на один сокет.

Это странно: процессоры почти бессмертны. Чтобы камень сгорел сам по себе — это как самолёт, летящий на одном двигателе: вероятность близка к нулю. Мы просим инженера: «Поменяйте процессоры местами. Если ошибка перейдёт на другой сокет — значит, дело в процессоре. Если останется — дело в материнке». И тут местная служба поддержки встаёт в позу: «Нет. Это технически сложная работа. Нам запрещено залезать внутрь оборудования клиента и трогать процессоры».

Пришлось вызывать инженера от нашего оператора связи (это другой человек, не сотрудник самого ЦОДа). Он приехал специально ради нас. Переставил процессоры, проверил каждый камень в каждом сокете, проверил даже термопасту. Вердикт: ошибка никуда не уходит, видеосигнала нет. Материнская плата считает, что сокет не работает, хотя процессор жив. Это на 99,9% — смерть материнки.

Отдельная история — это счета. Изначально сотрудники дата-центра попытались выставить нам счёт за шесть часов работы Remote Hands. Я едва сдержался от мата: «Как вы могли шесть часов нажимать на кнопку и перетыкать блоки питания?!» После скандала время сократили до двух часов, что тоже много, но уже не так нагло.

Мы попросили того самого инженера вытащить из сгоревшего сервера диски (в частности, с бэкапами) и физически воткнуть их в соседний живой сервер. Клиентам объяснили, что происходит, и предложили варианты:

— Развернуться из бэкапов на том, что есть (места мало, всех не вместим).

— Переехать в другой дата-центр.

— Получить компенсацию (в пятикратном размере от времени простоя по SLA).

Негатива не было вообще. Обычно в таких случаях клиентов прорывает, и их можно понять. Но тут были полная тишина и понимание. Большинство мы восстановили на соседних узлах. А часть клиентов сказала: «Ничего страшного, у нас там не критичные сервисы, неделю мы подождём, пока не приедет запчасть. Главное — не берите за это время денег». Мы, конечно, не только ничего с них не взяли, но и начислили компенсацию: кто-то получил пять недель бесплатного пользования.

Реклама ООО «МТ ФИНАНС» ИНН 7706424050