ИИ — не религия и не кнопка «сделать умнее»

Есть новая “болезнь”, которую я замечаю и у разработчиков, и у себя самого: хочется везде внедрить ИИ.

Кажется, что это универсальная кнопка. Нажал, и продукт стал умнее, нажал, и процессы сами поехали, нажал, и “человеческий фактор” исчез. И вот тут начинается самая опасная иллюзия.

Потому что ИИ - это не “лучше”, а чаще всего иначе. И иногда самый обычный, скучный, детерминированный алгоритм, написанный человеком, работает надежнее, предсказуемее и безопаснее.

Почему нас так тянет пихать ИИ везде? Да, потому что он реально умеет то, что недавно казалось невозможным. Он ускоряет черновую работу, помогает быстро найти информацию, выделить главное из массива, собрать первый драфт, разложить хаос по полкам. Но проблема начинается там, где ИИ ставят не “в помощь”, а “вместо”. Вместо правил и/или процессов, и не дай Боже вместо ответственности.

И тут появляется риск, который многие недооценивают. ИИ может ошибиться очень уверенно. Он может звучать правильно и убедительно, но быть неправым. А в продукте уверенная ошибка иногда хуже, чем честное “не знаю”.

Поэтому у нас внутри сформировался принцип, который мы постоянно себе напоминаем.

Сначала строим рельсы, потом добавляем ускоритель.

Рельсы - это простые вещи: правила, статусы, лимиты, проверяемые условия, логика доступа и понятные сценарии. Это то, что можно объяснить, проверить, воспроизвести и откатить. ИИ на таком фундаменте становится сильным помощником. Без него он превращается в рулевого, который иногда “угадывает”.

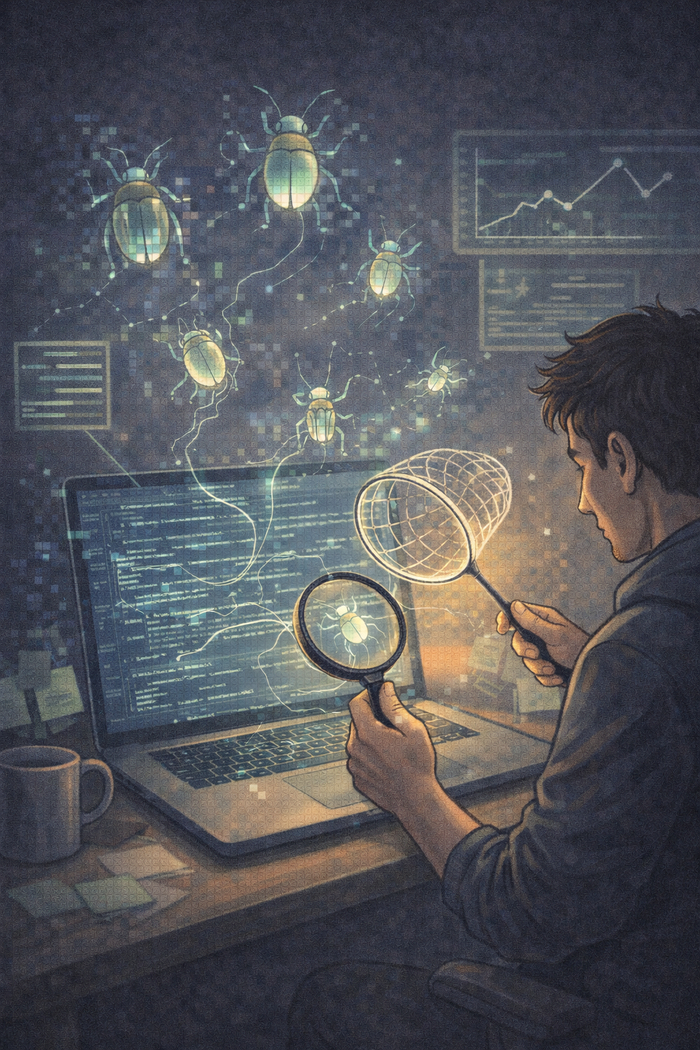

Есть еще один слой, который делает “ИИ везде” реально опасным — безопасность!!!

Если вы допускаете ИИ к процессам, где есть деньги, доступы, персональные данные, подтверждения действий, то вы делаете продукт не “умнее”. Вы расширяете поверхность атаки.

Причем атаки не всегда выглядят как “взлом”. Иногда это выглядит как “просто вопрос”.

В мире LLM (больших языковых моделей) для этого даже есть отдельный класс рисков. Prompt injection, когда модель пытаются заставить нарушить правила через специально сформулированный ввод. OWASP (международное некоммерческое сообщество, которое делает практические стандарты и рекомендации по безопасности веб-приложений) выделяет это как ключевой риск для приложений на больших языковых моделях. И если LLM подключен к инструментам или данным, последствия могут быть очень неприятными.

Поэтому мысль, которую я бы хотел донести, простая и взрослая. ИИ нельзя допускать туда, где он может принять финальное решение и где цена ошибки высока.

То есть ИИ - это не “везде”.

ИИ - это “там, где он усиливает человека”, а не подменяет систему.

И да, иногда очень хочется “быстрее” и “красивее”.

Но мы для себя приняли, что лучше быть скучными и надежными, чем модными и уязвимыми. Особенно в продуктах, где доверие важнее скорости.

Потому что вера в “ИИ закроет все потребности” - это тоже манипуляция. Только внутренняя. И если ее не останавливать, можно однажды проснуться в продукте, где много интеллекта, но мало ответственности.

Это не пост “против ИИ” и не попытка сказать, что его надо бояться. Наоборот, мы сами им пользуемся и будем пользоваться дальше. Просто ИИ — это инструмент, а не религия. Перед тем как “встроить его в продукт”, полезно остановиться и задать себе взрослые вопросы: где цена ошибки, кто отвечает за последствия, что будет, если модель ошибётся, можно ли начать с простого алгоритма и только потом усиливать его ИИ. Иногда самое правильное решение не самое модное, а самое устойчивое. И именно так, через взвешивание рисков и спокойный выбор архитектуры, ИИ действительно начинает помогать, а не добавлять уязвимости.

Реклама ООО «ЮНИК», ИНН: 7751240810 erid: CQH36pWzJqUzMjs4X5NsWnmzRs6uekJ7wK8s4AFirrHcfz