Представлен новый метод для улучшения точности не рассуждающих текстовых нейросетей

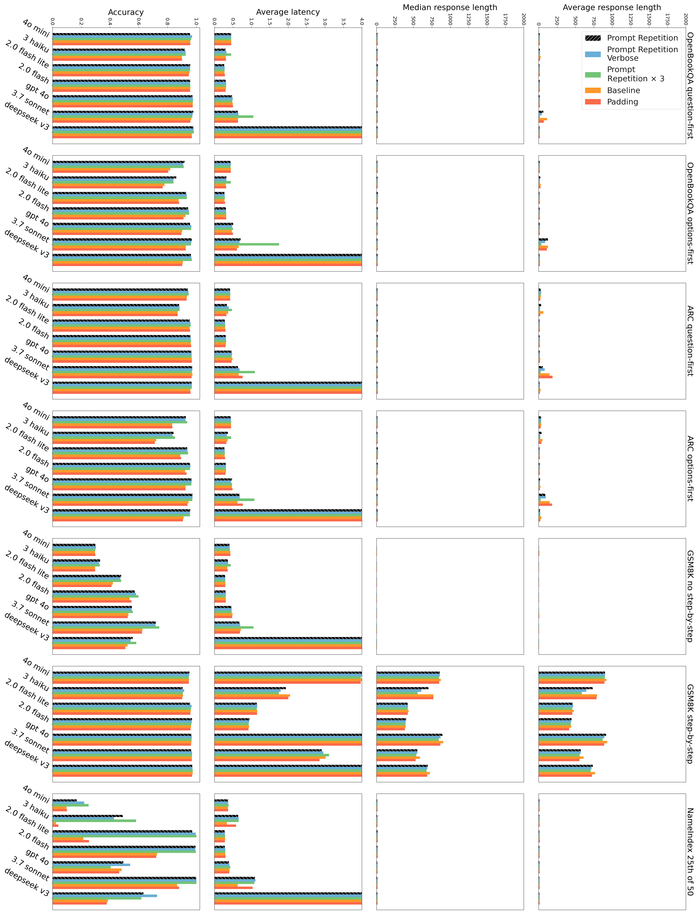

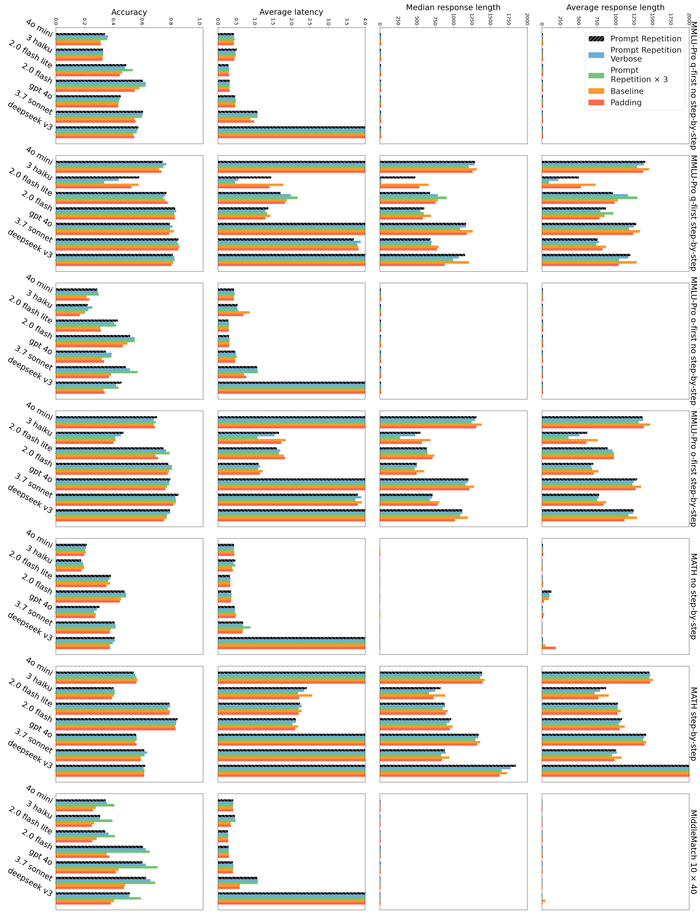

В выложенном отчёте (https://arxiv.org/abs/2512.14982) говорится о том, что преобразование запроса <ЗАПРОС> в <ЗАПРОС><ЗАПРОС> повышает точность популярных не рассуждающих моделей (Gemini, GPT, Claude, Deepseek) без увеличения длины ответа и задержки. Это связано с каузальной природой LLM, где повторение позволяет каждому токену учитывать все остальные, нивелируя влияние порядка.

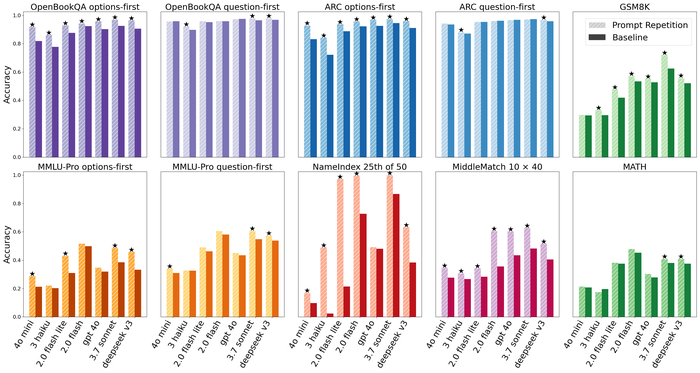

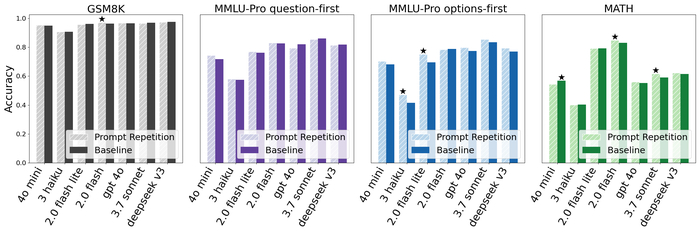

На 7 бенчмарках (OpenBookQA, ARC, GSM8K и др.) метод выиграл в 47 из 70 тестов (0 проигрышей), а наибольший прирост был, когда варианты ответов предшествуют вопросу. При включении рассуждений (think step by step) эффект нейтрален или слабо положителен (5 побед, 1 проигрыш). Всё потому, что рассуждающие модели в процессе мышления самостоятельно повторяют задачу несколько раз.

Метод не меняет формат вывода и легко внедряется.

Учитесь, как надо

Мир в очередной раз оказался прочней

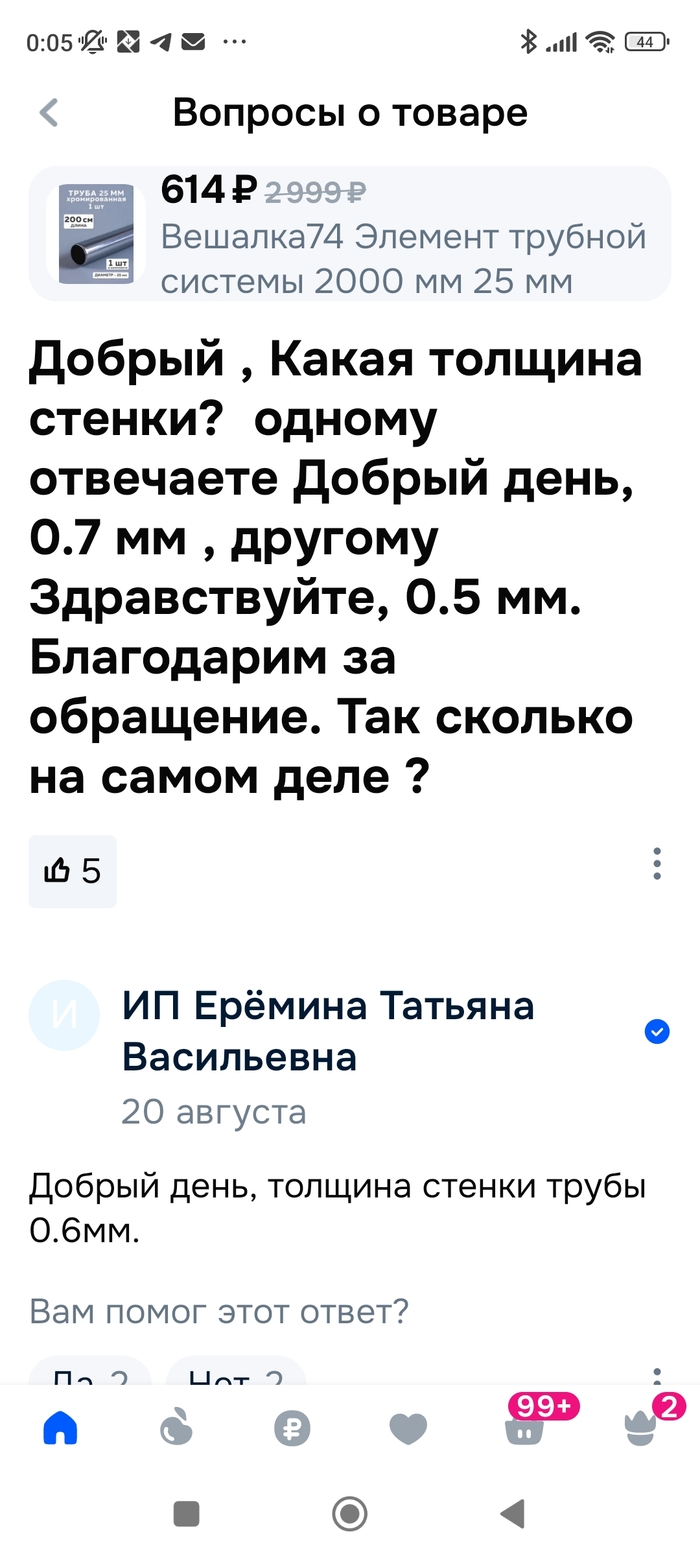

"Т" - точность!

В ролике демонстрируется владение очень точными приборами: Штангенциркуль и Микрометр.. детали подходят идеально! Используй КИП правильно!

Ну штангер и микрометр к КИП не относится... не придирайтесь, скажем так условно.

Пост явно носит юмористический характер - микрометром пользуются несколько иначе!

P.S. нахрена он (а судя по ногтям может и ОНА) натянул фитинги на пальцы даже предположить боюсь...