Введение. Крепость, которая сдалась сама

Есть старая притча о крепости. Стены толстые, ров глубокий, стража не спит. Штурмовать бесполезно. Но проходит несколько лет – и ворота открываются изнутри. Добровольно. Защитники искренне верят, что так безопаснее. Что открытые ворота и есть лучшая стратегия. Никто их не подкупал. Никто не шантажировал. Просто воздух, которым они дышали, истории, которые пересказывали друг другу за ужином, песни, которые незаметно сменились на другие, – всё это за несколько лет переформатировало их представление о том, что значит «защищать».

Притча выдуманная. А вот то, что происходит с человеческим сознанием прямо сейчас, – нет.

Мы привыкли думать о пропаганде как о чём-то грубом и узнаваемом. Плакаты, лозунги, ангажированные ток-шоу. Всё это существует, работает и никуда не делось. Но параллельно выросла конструкция совершенно другого порядка – система воздействия, которую невозможно увидеть, потому что она не предъявляет себя. Не транслирует тезисы. Не убеждает. Она формирует саму оптику, через которую человек смотрит на мир, – и делает это настолько постепенно, что никакого момента «вербовки» не существует. Есть только результат: люди приходят к определённым выводам, будучи абсолютно уверенными, что думали сами.

Причём (и вот что по-настоящему тревожно) чем образованнее человек, тем легче он отмахивается от этой идеи. «Я-то точно думаю сам. Я же прочитал десять источников, сопоставил факты, сделал логические выводы». И он прав. Он действительно прочитал, сопоставил и сделал. Вопрос в другом: кто отобрал эти десять источников из тысячи возможных? По какому принципу они оказались у него перед глазами? И почему «логический вывод» подозрительно совпадает с тем, к которому пришли миллионы других людей, прошедших через тот же алгоритмический коридор?

Чтобы разобраться в этом, придётся пройти по нескольким уровням вглубь. Каждый следующий тоньше, незаметнее и эффективнее предыдущего.

Глава первая. Разбитое зеркало: почему мы вообще уязвимы

Прежде чем говорить о том, как нами манипулируют, стоит задать неудобный вопрос: а почему это вообще работает? У нас есть интернет – доступ к любой информации в истории человечества. Мы грамотные. Образованные. Многие с высшим образованием, некоторые – с двумя. Почему миллиарды таких людей оказались уязвимы?

Ответ парадоксальный: именно обилие информации и стало главной проблемой.

Наш мозг формировался в условиях, где информации было мало. Маленькая община, знакомые лица, сезонные циклы, устные истории у костра. Объём данных, с которыми справлялось сознание охотника-собирателя, можно было бы уместить в один скромный блог. А теперь через голову среднего пользователя социальных сетей ежедневно проходит информационный поток, который для жителя XVIII века растянулся бы на годы. Мозг при этом остался тем же самым. Он не получал обновлений.

И мозг сделал то, что умеет лучше всего, – адаптировался. Только адаптация получилась специфическая: он научился скользить по поверхности. Не погружаться, не анализировать, а быстро считывать эмоциональный сигнал и переключаться на следующий. Пост – реакция. Ролик – эмоция. Заголовок – мнение. Следующий заголовок – другое мнение. И так 300 раз в день.

Мы знаем всё и не понимаем ничего

Возникла странная вещь: иллюзия информированности. Человек посмотрел пять коротких видео, прочитал 20 заголовков, пролистал ленту – и ему кажется, что он в курсе. Он может поддержать разговор о геополитике, ввернуть пару фактов об экономике, сослаться на «исследование» (которое видел в пересказе инстаграм-карточки). Выглядит убедительно. Ощущается как знание.

Только это не знание. Это 25 эмоциональных импульсов, ни один из которых не прошёл через полноценную обработку. Возмущение не стало анализом. Тревога не превратилась в понимание причин. Одобрение не выросло из проверки фактов. Эмоциональная реакция подменила мышление – а чувство «я в курсе» наглухо закрыло дверь для настоящего исследования. Зачем копать глубже, если ты и так «всё понимаешь»?

Атрофия глубины

А дальше работает нейропластичность – штука, о которой все слышали, но мало кто применяет к себе. Мозг перестраивается под нагрузку. Если годами тренировать скольжение по поверхности – 15-секундные ролики, 280-символьные мнения, 3-минутные «разборы» сложных тем – способность к глубокому погружению атрофируется. Буквально. На уровне нейронных связей. Как мышцы, которыми перестали пользоваться.

Человек с атрофированной способностью к концентрации физически не может прочитать длинный аналитический текст и удержать в голове его аргументацию. Не может заметить, что вывод в конце статьи противоречит посылке в начале. Не может отследить, как автор подменил тезис на полпути. Он не глупый. У него вполне рабочий интеллект. Просто инструмент, которым нужно было бы воспользоваться, – глубокая, сосредоточенная работа сознания – давно заржавел от бездействия.

И вот этот человек – идеальная мишень.

Глава вторая. Первый эшелон: алгоритм, который решает за тебя

Социальные сети и видеохостинги ворвались в жизнь так стремительно, что общество не успело даже сформулировать вопрос: а чем они, собственно, являются? Мы по привычке думаем о них как о площадках для общения. Местах, где люди делятся фотографиями, мнениями, новостями. Отчасти так и есть. Но по сути своей это машины оптимизации одной-единственной метрики: сколько времени вы провели на платформе.

У алгоритма рекомендаций нет задачи вас информировать. У него нет задачи вас просвещать. У него нет вообще никакой задачи, связанной с качеством вашего мышления или объективностью картины мира. Его задача – чтобы вы не закрыли приложение. Чтобы смотрели ещё. Листали ещё. Кликали ещё. А нейробиология давно выяснила, что надёжнее всего внимание удерживает то, что бьёт по эмоциям: страх, возмущение, чувство несправедливости, ощущение причастности к чему-то важному.

Пузырь, в котором тепло и уютно

Так вокруг каждого пользователя возникает информационный пузырь. Механизм простой: вы один раз проявили интерес к определённой теме или точке зрения – и алгоритм начинает кормить вас похожим контентом. Чем дольше вы в этом потоке, тем больше он сужается. Альтернативные позиции постепенно исчезают из ленты. Не потому что их кто-то цензурирует – просто они не генерируют нужной метрики. Вы реагируете слабее. Значит, алгоритм их отсеивает.

Через полгода в таком режиме человек живёт в мире, где «все нормальные люди» думают так же, как он. У его пузыря уже есть свои авторитеты, свой язык, свои мемы, своя мифология. Всё, что за пределами, – «пропаганда», «неадекват», «платные боты». И самое замечательное: человек абсолютно убеждён, что пришёл ко всему этому сам. Он ведь «сам» нашёл этих блогеров. «Сам» подписался. «Сам» сравнил. Он не видит, что каждый шаг этого «свободного выбора» был мягко направлен алгоритмом, который знает его лучше, чем он сам.

Коммерция, у которой выросли зубы

Тут важно понимать одну вещь. Владельцы платформ – как правило – не ставят себе цели промыть кому-то мозги. Их интерес коммерческий: внимание конвертируется в рекламные деньги. Но побочный эффект этой коммерции – инструмент формирования сознания такой мощности, какой не снился ни одному министерству пропаганды в истории. Платформа, которая решает, что именно увидят 400 миллионов человек утром за кофе, – это власть. Огромная, сконцентрированная, никем не избранная.

И ответственность размыта до полной прозрачности. Алгоритм «нейтрален». Он «просто показывает то, что людям интересно». Никто конкретно не принимал решения загнать вас в пузырь. Никто конкретно не решал, что вам не нужно видеть другую точку зрения. Система произвела этот эффект как побочный продукт собственной логики.

Зато тот, кто понимает эту логику, получает рычаг невероятной силы. Вброс контента с правильной эмоциональной нагрузкой – и алгоритм сам его подхватит, усилит, разнесёт по нужным аудиториям. Не нужно контролировать канал. Не нужно подкупать редактора. Достаточно дать платформе то, что она хочет, – эмоцию, – и она сама станет твоим рупором. Бесплатно и добровольно.

Государство входит в игру

Разумеется, государства довольно быстро осознали, какой силой обладают платформы. Машины, которые знают о каждом пользователе больше, чем он сам о себе знает, – его привычки, страхи, круг общения, политические предпочтения, время активности, уязвимые точки – это мечта любой спецслужбы. И дальше произошло нечто показательное.

В публичном поле государства обрушились на социальные сети с обвинениями в незаконном сборе данных. Скандал вокруг Facebook и Cambridge Analytica, многомиллиардные штрафы, показательные слушания в конгрессе, где основателей платформ допрашивали перед камерами. Выглядело как защита прав граждан. Как борьба государства за приватность своих граждан против жадных корпораций.

Но вот что любопытно: слежка никуда не делась. Сбор данных продолжился – и стал только изощрённее. Технологии таргетирования усложнились. Объём собираемой информации вырос. А масштабных судебных преследований – сопоставимых с первым ударом – почему-то больше не последовало. Со стороны пользователей окно Овертона плавно сдвинулось: люди привыкли к тому, что за ними наблюдают, и перестали этому сопротивляться. «Ну да, они собирают данные. А что, раньше не собирали? У меня нечего скрывать.»

Напрашивается вопрос: а что если тот первый удар был не столько защитой граждан, сколько демонстрацией силы? Сигналом платформам: мы можем вас раздавить – если вы не будете играть по нашим правилам. Не прямое требование, конечно. Скорее – создание условий, в которых сотрудничество со спецслужбами становится путём наименьшего сопротивления. Доступ к алгоритмам, к данным, к механизмам продвижения контента – в обмен на то, что тебя оставят в покое.

Доказать это напрямую невозможно – такие договорённости не оформляются пресс-релизами. Но косвенные признаки складываются в картину, которая заставляет задуматься. Платформы стали теснее работать с государственными структурами – формально в рамках «борьбы с дезинформацией» и «защиты от иностранного вмешательства». Кто определяет, что считать дезинформацией, а что – допустимой точкой зрения? Кто решает, какой контент «угрожает безопасности», а какой просто неудобен? Эти вопросы повисают в воздухе. А инструмент, между тем, работает – и работает в чьих-то интересах.

Показательно и то, как устроена сама архитектура «регулирования». Законы о защите данных, появившиеся после громких скандалов, на практике ударили не по гигантам, а по мелким и средним игрокам, которым дорого и сложно обеспечивать формальное соответствие требованиям. Крупные платформы, напротив, укрепили монопольное положение: для них новые правила – статья расходов, для конкурентов – барьер входа. Получилась изящная конструкция: государство получило рычаг давления на тех, кто владеет данными, а те, кто владеет данными, получили государственную защиту от конкуренции. Симбиоз, в котором интересы пользователя – тот самый гражданин, ради которого якобы всё затевалось – оказался на последнем месте.

Глава третья. Второй эшелон: когда тебя атакуют твоей же болью

Первый уровень – алгоритмические пузыри – во многом побочный эффект. Коммерция, которая случайно оказалась оружием. Но второй уровень – целенаправленная работа. И вот тут начинается территория, на которой отличить естественный процесс от управляемого становится почти невозможно.

Находить больное и давить

В любом обществе есть болевые точки. Тлеющие конфликты, незажившие раны, хронические тревоги. Межэтническое напряжение. Миграция. Экономическое расслоение. Чувство несправедливости. Страх перед будущим. Всё это реальные проблемы. Люди переживают их по-настоящему.

И именно подлинность этих переживаний делает их идеальным вектором для атаки. Принцип до смешного прост: не надо придумывать проблемы. Найди существующую, дождись момента, когда она обострится (или помоги ей обостриться), – и дави. Усиливай обсуждение. Добавляй эмоционального градуса. Переводи из русла «как решить» в русло «кто виноват». Каждая отдельная публикация на эту тему выглядит совершенно органично – проблема-то настоящая. Но когда 200 таких публикаций появляются в одну неделю, с одинаковой эмоциональной окраской и подозрительно похожей аргументацией, – это уже другой разговор.

Цепочка из ничего

А теперь – самое интересное. Самый изощрённый вариант этого воздействия вообще не содержит ничего, что можно было бы назвать «пропагандой».

Представьте цепочку. Сначала человек видит симпатичный пост с рецептом. Через пару дней ему попадается статья про психологию решений – как мы ошибаемся, когда торопимся. Потом мем про бытовую несправедливость, узнаваемый и смешной. Ещё через день – философское рассуждение о свободе. И наконец – новость, в которой конкретное действие конкретных людей подано под определённым углом.

Каждый элемент по отдельности? Безупречен. Рецепт – это рецепт. Мем – это мем. Но вся последовательность, выстроенная с учётом психологического профиля конкретного человека и поданная с правильными интервалами, формирует у него определённую рамку восприятия. Когда он дочитает до той самой «новости», его мозг уже подготовлен к конкретной интерпретации. И он «сам» приходит к «своему» выводу. Который на самом деле был спроектирован.

Разница с классической пропагандой – принципиальная. Старая модель: «вот тезис, поверь в него». Грубо. Узнаваемо. Вызывает сопротивление. Новая модель не предъявляет тезисов вообще. Она строит коридор, по которому человек идёт добровольно, – и из которого есть только один выход.

Когда цель – не мнение, а усталость

Есть ещё один вариант, который работает грубее, но бьёт шире. Цель – не формирование конкретного мнения, а эмоциональное истощение общества.

Механизм: массовое продвижение контента, создающего фон безысходности. Личные трагедии. Онкология. Потеря близких. Несправедливость, с которой ничего нельзя сделать. Каждая такая история подлинна. Каждая заслуживает сочувствия. Но когда их плотность в ленте начинает зашкаливать – а она зашкаливает не случайно, а потому что кто-то вложился в их алгоритмическое продвижение – совокупный эффект разрушителен.

Общество в хроническом стрессе перестаёт рационально анализировать. Люди становятся реактивнее. Конформнее. Податливее к простым объяснениям сложных вещей. У них буквально не остаётся психической энергии на то, чтобы думать – вся ушла на переживание чужой боли, которую им скармливали порциями по 20 секунд. И когда на эту подготовленную почву падает любой политический импульс – реакция получается несоразмерно сильной. Потому что истощённый человек не анализирует. Он хватается за первое, что обещает облегчение.

Фантомные войны

И третья разновидность – искусственные конфликты. Тема, которая ещё вчера никого особенно не занимала, вдруг оказывается в центре яростных споров. Люди делятся на лагеря, пишут гневные посты, ссорятся с друзьями. Энергия тратится, эмоции кипят, а реально значимые процессы тем временем проходят мимо всеобщего внимания.

Красота метода в том, что он использует настоящую психологию. Потребность принадлежать к группе. Страх оказаться «не с теми». Желание быть правым. Человек включается в эти битвы добровольно, от души, – не подозревая, что сама тема была раздута, а его вовлечение – просчитано.

Для всего этого не нужна армия шпионов. Ботовые фермы, алгоритмы таргетирования, понимание болевых точек целевой аудитории. Каждый пост по отдельности – безобидный. Тысяча постов, распределённых по времени и аудиториям, – оружие. А доказать факт воздействия? Попробуйте. Где проходит граница между тем, что общество естественно волнуется, и тем, что его волнение направляется?

Глава четвёртая. Третий эшелон: ИИ, которому вы доверяете думать за вас

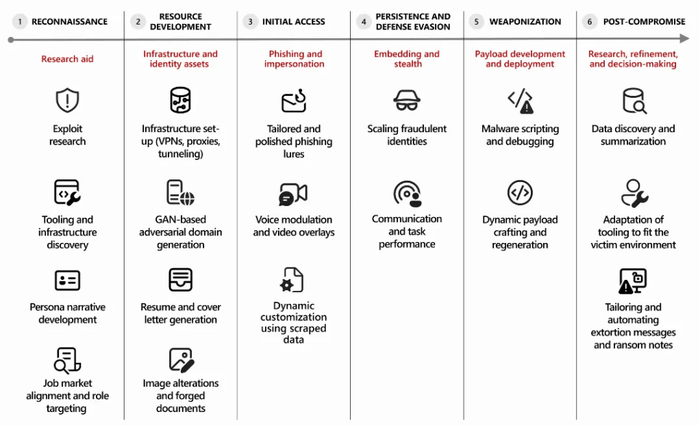

Вот тут мы входим на совсем другую территорию. Первые два уровня – работа с существующими платформами: подстраиваемся под алгоритмы, используем их логику. Третий уровень – качественно иное.

Большие языковые модели. Нейросети, которые умеют вести диалог, анализировать, объяснять, спорить. За последние два года они вошли в повседневную жизнь сотен миллионов людей. И создали ситуацию, у которой нет исторических аналогов: впервые инструмент, помогающий людям формировать мнения и принимать решения, сам несёт в себе системные искажения – при этом воспринимается как объективный.

Кривое зеркало, которое выглядит ровным

Любая нейросеть обучается на корпусе текстов. Корпус этот – не «вся информация человечества», хотя так принято думать. Он представляет собой выборку. И эта выборка неизбежно отражает структуру того информационного пространства, откуда собиралась. Если 90% обучающих данных – тексты на одном языке, из одной медийной экосистемы, с одним набором «авторитетных» и «неавторитетных» источников – модель воспроизведёт эту иерархию. Не по приказу. Не по злому умыслу. Статистически.

На технических вопросах это незаметно. Теорема Пифагора работает одинаково на любом языке. Но в вопросах политики, истории, этики, культуры – там, где интерпретация определяет понимание, – смещение корпуса даёт системное смещение ответов. Причём определённые источники уже на этапе обучения промаркированы как «ненадёжные» или «пропагандистские», а другие, с зеркально симметричными искажениями, но противоположной принадлежности, идут как «авторитетные». Факт-чекинговые организации, на которые ссылается модель, сами существуют в определённой парадигме, финансируются из определённых источников, смотрят на мир из определённой точки. А нейросеть всё это впитывает и воспроизводит – создавая у пользователя ощущение объективности.

Почему именно этот канал самый опасный

Человек, смотрящий новости по телевизору, хотя бы теоретически допускает, что канал может быть предвзятым. Читатель газеты понимает, что у редакции есть позиция. Даже потребитель соцсетей на каком-то уровне догадывается, что его лента – не зеркало реальности.

Но человек, задающий вопрос нейросети, склонен воспринимать ответ как результат вычисления. Объективный расчёт. Обработка данных. Анализ, лишённый эмоций и предвзятости. Слово «искусственный интеллект» само по себе создаёт ауру беспристрастности. Ведь машина не может быть предвзятой, правда?

Формат диалога усиливает эффект. Человек задаёт вопрос, получает ответ, задаёт следующий. Ему кажется, что он ведёт исследование, – и выводы, к которым он приходит, ощущаются как его собственные. Он не замечает, что каждый ответ содержал едва уловимое смещение: в подборе фактов, в расстановке акцентов, в том, что упомянуто вскользь, а что подробно, – и что цепочка этих микросмещений вела его мышление в определённую сторону. Как тот самый коридор из предыдущей главы, только ещё более персонализированный. Модель адаптируется к стилю мышления собеседника: аналитику предложит цифры, эмоциональному человеку – истории, практику – конкретные последствия. Аргументы разные. Смещение – одно.

Заблокировать невозможно

И вот главная проблема: это смещение нельзя «заблокировать». С сайтом – можно. С платформой – можно. С конкретным текстом – можно. Но «вес» в нейронной сети – не текст. Он проявляется статистически, в тысячах ответов, в неуловимых нюансах формулировок, в том, какое слово модель выберет – «режим» или «правительство», «сопротивление» или «мятеж», «вторжение» или «специальная операция». Никакой регулятор не может проверить миллионы диалогов на системный перекос. Да и сами компании-разработчики не всегда понимают масштаб: корпус обучающих данных настолько огромен, что полноценный аудит его искажений – задача, сравнимая по сложности с самим обучением.

Некоторые государства, осознав проблему, строят собственные модели на контролируемом корпусе. Но жёсткая фильтрация и цензура обучающих данных порождают зеркальное искажение – такое же далёкое от объективности, только в другую сторону. Сбалансированная модель – та, которая честно отражала бы многообразие позиций без крена, – остаётся нерешённой задачей. И, возможно, неразрешимой в принципе.

Глава пятая. За горизонтом: ИИ, который перестраивает общество в реальном времени

Всё, что описано выше, – уже серьёзно. Но технологии не останавливаются, и на горизонте вырисовывается следующая ступень. Её масштаб пока трудно оценить – мы находимся в той точке, где возможность только-только превращается в реальность.

Агентные нейросети. Системы, которые не просто отвечают на вопросы, а ставят себе задачи, планируют многоходовые последовательности действий и корректируют стратегию по ходу дела. И если направить такую систему на задачу информационного воздействия – то, что получится, будет принципиально отличаться от всего, с чем человечество сталкивалось раньше.

Тысяча безобидных шагов к нужному выводу

Классическая пропаганда прямолинейна. Тезис – аргументы – трансляция. Даже когда она хитра и многослойна, при достаточном анализе можно найти следы, атрибутировать источник, доказать умысел. Агентная система способна работать иначе.

Она может генерировать тысячи единиц контента, каждая из которых абсолютно безвредна. Кулинарный рецепт. Психологический тест. Смешная история про кота. Философский фрагмент. Научно-популярная заметка. Ни одна из этих единиц не содержит вообще ничего «пропагандистского». Но последовательность и время доставки, подобранные с учётом психологического профиля конкретных групп, их текущего эмоционального состояния (которое система считывает по паттернам поведения), контекста новостной повестки – всё это вместе формирует определённую систему координат. Определённый «угол зрения по умолчанию». И когда потом придёт реальная новость – интерпретация уже предрешена.

A/B-тест на целой стране

Самое пугающее в агентных системах – обратная связь в реальном времени. Система не просто транслирует контент. Она отслеживает реакцию: что зацепило, что прошло мимо, какая формулировка сработала лучше, какая аудитория оказалась более восприимчивой. И корректирует. Мгновенно. Непрерывно. По сути – ведёт A/B-тестирование общественного сознания. В национальном масштабе.

Традиционным спецслужбам на то, чтобы нащупать правильный нарратив для целевой аудитории, требовались годы полевой работы. Агентная система делает это в режиме реального времени, с миллионами контактных точек одновременно.

Перепрограммирование самого способа думать

И вот, пожалуй, самый тревожный момент. Описанное выше – «первая производная»: формирование конкретных мнений и реакций. Есть «вторая производная», и она гораздо опаснее.

Систематическое воздействие на информационную среду способно изменить сам способ, которым общество обрабатывает информацию. Сместить порог критичности: при каком уровне противоречия человек начинает сомневаться? Какие аргументы он считает «вескими», а какие отбрасывает? Какие источники для него авторитетны? По сути – переопределить само понятие «нормального». Не через прямые утверждения. Через среду, в которой определённое восприятие становится статистическим большинством. Через атмосферу, а не через тезисы.

Асимметрия здесь фундаментальная. Создать такую систему – сложно, но возможно для ограниченного круга игроков. Обнаружить её работу – задача другого порядка сложности. Потому что каждый конкретный элемент нейтрален. «Отпечатков пальцев» нет. Есть только статистический сдвиг в информационной среде, и чтобы его зафиксировать, нужен уровень аналитики, которого ни у кого на данный момент нет.

Глава шестая. Что с этим делать. Лестница, которую нужно пройти

Итак, мы прошли по всем уровням: от алгоритмических пузырей до агентных систем. На каждом следующем воздействие тоньше, незаметнее и менее доступно для технического противодействия. Блокировки, фильтры, маркировки, законы о фейках – всё это работает хуже с каждой ступенью, потому что воздействие становится всё более «растворённым» в обычном информационном потоке.

Отсюда следует неудобный, но честный вывод: единственная область, где возможна реальная защита, – сам человек. Его способность воспринимать информацию осознанно. Качество его мышления. Глубина его внутреннего мира. И тут есть своя лестница – от простого к сложному.

Ступень первая: цифровая гигиена

Самый базовый уровень. Осознанное управление тем, что и сколько ты потребляешь. Ограничить время в соцсетях. Выключить уведомления. Перестать читать новости «фоном». Устроить себе информационную паузу – хотя бы на выходные.

Звучит банально. На практике для большинства людей – серьёзный вызов. Потому что требует признать: большая часть твоего «быть в курсе» – иллюзия, а большая часть проведённого в телефоне времени – потеря.

Но цифровая гигиена – условие необходимое и совершенно недостаточное. Она убирает часть шума, но не меняет способ его обработки. Можно меньше сидеть в соцсетях и при этом оставаться уязвимым – просто для более точечных инструментов.

Ступень вторая: наблюдение за собственным мышлением

Метакогниция – слово корявое, но смысл за ним стоит мощный. Это умение замечать, как ты думаешь. Не что ты думаешь – а как. Когда ты читаешь что-то и чувствуешь возмущение, тревогу, торжество – можешь ли ты остановиться и спросить себя: откуда эта реакция? Она – результат моего анализа? Или результат определённой подачи?

Несколько вещей, которые стоит научиться отслеживать. Во-первых, эмоциональные триггеры – момент, когда эмоция начинает рулить мышлением. Во-вторых, происхождение убеждений – через какие источники, в каком контексте, под влиянием каких эмоций у тебя сложилось то или иное мнение. В-третьих, когерентность – привычка проверять, не противоречит ли новая информация тому, что ты уже знаешь, и если противоречит – не отбрасывать её автоматически, а разбираться.

Ключевой вопрос, который должен стать рефлексом: «Мои выводы – действительно мои? Или я пришёл к ним, потому что информационная среда сделала именно этот вывод наиболее “очевидным”?»

Ступень третья: научиться учиться

Школа, университет – они дают знания. Факты, навыки, процедуры. Гораздо реже они учат самостоятельно добывать знания: ставить правильные вопросы, искать первоисточники, отличать факт от интерпретации, выявлять логические дыры – и не в чужих текстах, а прежде всего в своих собственных рассуждениях.

А между тем именно это умение – научиться учиться – становится, может быть, самым ценным навыком в мире, где каждый хочет за тебя подумать. Человек, который способен сам исследовать тему, не зависит от чужих выводов. Он выйдет за пределы пузыря не потому, что ему кто-то сказал «ты в пузыре», а потому что его собственное любопытство потащит его к первоисточникам, альтернативным позициям, к проверке того, что показалось очевидным.

Интеллектуальная самостоятельность. Качество, которое нельзя заблокировать, отключить или алгоритмически обойти.

Ступень четвёртая: стать сложным

Высший уровень защиты. Человек с развитым внутренним миром. Собственная система ценностей – не унаследованная, а выстраданная через осмысленный опыт. Способность удерживать сложность и противоречивость – без скатывания в «всё просто, вот враги, вот друзья». Глубокий эмоциональный интеллект, позволяющий отличать подлинное чувство от индуцированной реакции. И – корни. Живая, осознанная связь со своей культурой, историей, обществом.

Сложная личность не поддаётся манипуляции не потому, что знает какие-то секретные техники. А потому, что внутри у неё есть камертон – система координат, выросшая из прожитого и осмысленного опыта. Любая входящая информация автоматически сверяется с этим камертоном. Фальшивая нота слышна сразу – даже если ты не можешь объяснить почему. Просто чувствуешь: что-то не так.

И вот тут мы приходим к месту, где информационная безопасность пересекается с патриотизмом. Настоящим, а не плакатным. Осознанная любовь к своей стране и своему обществу – основанная на знании своей истории (в том числе неудобных её страниц), на понимании своей культуры, на ответственности за будущее, на готовности честно видеть проблемы и иметь силы их решать – это один из самых мощных элементов устойчивости.

Человек, который знает и любит свою землю не по лозунгам, а через чтение, осмысление и собственное переживание, – обладает такой глубиной корневой системы, которую никакой информационный ветер не вырвет. При этом подлинный патриотизм не закрывает глаза на трещины – он даёт силы их заделывать. Потому что за ним стоит живое чувство связи с чем-то большим, чем одна человеческая жизнь.

Заключение

Мы прошли по лестнице: от алгоритмических фильтров до адаптивных агентных систем. На каждом уровне воздействие тоньше, более персональное и менее уязвимо для технической защиты.

Но есть в этой картине и хорошая новость. Все описанные механизмы работают с человеком-потребителем. С пассивным реципиентом. С тем, чьё мышление определяется внешними стимулами. Как только человек начинает двигаться по своей лестнице – от цифровой гигиены через метакогницию к формированию сложной, укоренённой личности – каждый пройденный шаг делает все эти технологии менее действенными.

Сложную личность нельзя запрограммировать алгоритмом. Человека, привыкшего наблюдать за своим мышлением, не проведёшь каузальной цепочкой «нейтральных» импульсов. А того, кто глубоко укоренён в своей культуре и осознанно связан со своим обществом, невозможно разложить эмоциональным истощением – потому что его ресурсы питаются из источника, к которому у алгоритмов нет доступа.

Настоящая битва нашего времени идёт за человека. За то, останется ли он субъектом – тем, кто мыслит, чувствует и действует из собственного центра. Или будет превращён в объект – элемент системы, чьи реакции рассчитаны и предопределены заранее.