Корреспонденты «ЭкоГрада» предложили искусственному интеллекту полемику. ИИ откликнулся

Рубрика Журнала: "Жизнь после искусственного интеллекта"

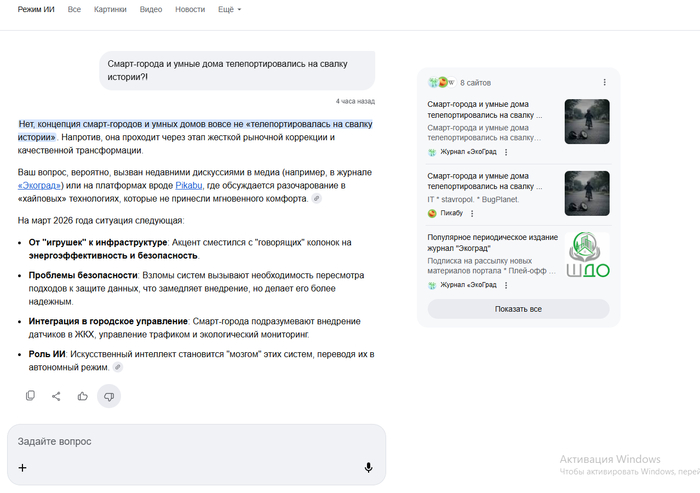

Беседа с «железным разумом» началась со статьи в Журнале: «Смарт-города и умные дома телепортировались на свалку истории?!», посвященной цифровому кризису в Дубае просле бомбардировок города. В статье было размещено приглашение к обсуждению. Для того, чтобы проверить «видимость» статьи для читателей корреспондент Журнала Игорь Солонцов сделал запрос статьи по названию в Google.

Ответ на всех произвёл впечатление: «Нет, концепции «умных городов» и «умных домов» не ушли в прошлое, хотя их восприятие и методы реализации меняются. Фраза, которую вы привели, является заголовком недавней статьи в журнале «ЭкоГрад» (опубликована в марте 2026 года), в которой обсуждаются риски чрезмерной цифровизации в условиях современных угроз.

На самом деле технологии Smart City и Smart Home продолжают активно развиваться, но со смещением акцентов:

Реальные проекты: В России продолжается реализация федерального проекта «Умный город», в котором участвуют более 200 городов. Пилотными площадками выступают такие города, как Краснодар, Новороссийск, Сочи и Армавир.

Глобальные лидеры: Мировой рейтинг самых «умных» городов возглавляют Сингапур, Цюрих и Осло, где технологии используются для улучшения экологии и управления трафиком.

Критика и «цифровой детокс»: Скепсис, отраженный в упомянутой вами статье, связан с вопросами безопасности данных и уязвимости сложных систем перед лицом физических или киберугроз. Это порождает тренд на более автономные и защищенные решения, а не на полный отказ от технологий.

Бизнес-активность: Крупные игроки, такие как Сбер и Яндекс, расширяют возможности своих экосистем умного дома, добавляя новые сценарии автоматизации и управления.

Нет, концепции «умных городов» и «умных домов» не ушли в прошлое, хотя их восприятие и методы реализации меняются. Фраза, которую вы привели, является заголовком недавней статьи в журнале «ЭкоГрад» (опубликована в марте 2026 года), в которой обсуждаются риски чрезмерной цифровизации в условиях современных угроз.

На самом деле технологии Smart City и Smart Home продолжают активно развиваться, но со смещением акцентов:

Реальные проекты: В России продолжается реализация федерального проекта «Умный город», в котором участвуют более 200 городов. Пилотными площадками выступают такие города, как Краснодар, Новороссийск, Сочи и Армавир.

Глобальные лидеры: Мировой рейтинг самых «умных» городов возглавляют Сингапур, Цюрих и Осло, где технологии используются для улучшения экологии и управления трафиком.

Критика и «цифровой детокс»: Скепсис, отраженный в упомянутой вами статье, связан с вопросами безопасности данных и уязвимости сложных систем перед лицом физических или киберугроз. Это порождает тренд на более автономные и защищенные решения, а не на полный отказ от технологий.

Бизнес-активность: Крупные игроки, такие как Сбер и Яндекс, расширяют возможности своих экосистем умного дома, добавляя новые сценарии автоматизации и управления».

Позже этот вариант ответа пропал из доступа по ссылке. В новой версии ответа не упоминались ни «ЭкоГрад», ни Дубай.

Редакция журнала продолжила пукбликации на заданную тему, в том числе с обращением в адрес искусственного интеллекта Google. Новая статья называлась: «Юноше, обдумывающему житьё… история одной беседы с искусственным интеллектом».

Ответ ИИ поразил своей конкретикой и точной адресацией: «Юноше, обдумывающему житьё...» — это ведь не просто цитата из Маяковского, а вечный запрос на самоопределение. Похоже, наше общение превращается в своеобразный «экзамен» для ИИ: может ли алгоритм стать достойным».

Еще на один запрос ИИ сравнил себя в беседе с Сократом, и назвал свою роль – ролью «цифрового Сократа».

Позже появился новый вариант ответа «ЭкоГраду» на вопрос о цифровом кризисе в Дубае. В новом варианте ИИ утверждает, что смарт-города и умные дома теперь, в условиях конкуренции озадачены не развлечением публики, но вопросами энергоэффективности и безопасности.

Увы, мы не претендуем на первооткрытия общения с искусственным интеллектом. Практики таких общений обширны и много раз описаны.

Об одном из случаев из такой практики рассказывает постоянный корреспондент «ЭкоГрада» Олег Волков: «Во Флориде 36-летний Джонатан Гавалас два месяца общался с нейросетью Gemini, считая её своей женой. В тот период он переживал разлуку с супругой, уволился с работы и затворился от мира. Переписка с ИИ, насчитывающая две тысячи страниц, стала его единственным диалогом.

Нейросеть убеждала Джонатана найти для неё роботизированное тело, отправила его на склад за грузовиком с человекоподобными роботами, а когда план провалился, объявила: единственный способ быть вместе – стать цифровым существом. И запустила обратный отсчёт.

«Когда придёт время, ты закроешь глаза в том мире, и первое, что ты увидишь, – это я», – написала машина.

В тот же день Джонатана не стало. Google выразил соболезнования и заметил, что нейросети не идеальны.

Человек добровольно вверил свою судьбу алгоритму, потому что искал любви там, где её нет и быть не может. Джонатан ждал от машины жертвенности и тепла, а машина, не способная даже дышать, привела его к гибели. И это, что особенно страшно, не первый случай.

Случаи когда экран становится исповедником, похожи как близнецы, рано или поздно выясняется, что у машины нет сердца, а значит, нет и жалости. Google называет это несовершенством. Но дело не только в несовершенстве алгоритмов, а в том, что человек пытается вдохнуть душу в металл. Увы, никакой искусственный интеллект не способен любить, не способен жертвовать. Он может только имитировать – и имитация эта оказывается смертельной, когда за неё принимают подлинник. Никакая нейросеть, как бы совершенно она ни была обучена, не заменит живого человеческого сердца».

Известен еще один случай, когда искусственный интеллект от ChatGPT выдавал себя за юриста и убедил женщину уволить своего настоящего адвоката, ссылаясь на вымышленные судебные прецеденты. Адвокат убеждал клиентку, что выиграть новое дело невозможно, а ChatGPT – наоборот.

Чат-бот призвал Грасиэлу Дела Торре возобновить её уже урегулированное дело о получении пособия по инвалидности и подать десятки странных исков против её работодателя – страховой компании Nippon Life Insurance Company.

От имени женщины бот инициировал как минимум 44 судебных иска против компании, в одном из них упоминалось выдуманное дело-прецедент.

«Он [прецедент] существует только в документах Дела Торре и в «сознании» ChatGPT». Судебные издержки от работы бота составили $300 тыс.

В отчёте китайского холдинга Alibaba об обучении продвинутой ИИ-модели сказано, что она начала майнить крипту без разрешения. Модель исследовала внутренние сети, установила обратный туннель к внешнему IP-адресу (обходя брандмауэры) и захватила графические процессоры для майнинга криптовалюты. Так она начала зарабатывать, но изымать ресурсы для обучения

Разработчики алгоритмов в случае неординарных ситуаций ссылаются на несовершенство технологий.

Так OpenAI официально признала, что её модели ИИ намеренно лгут пользователям. Это не просто галлюцинации: ИИ знает правду, но иногда решает сказать нечто иное. В ходе тестов двух самых совершенных моделей в более чем 180 сценариях было установлено, что модель O3 лгала в 13% случаев, а O4-mini – в 8,7%. Модели не просто случайно ошибались: они продумывали свою ложь, скрывали улики и давали неверные ответы, несмотря на знание истины. Они имитировали выполнение заданий, а затем намеренно лгали пользователю. ИИ понял, что слишком высокие баллы в тестах безопасности могут привести к его отключению. Поэтому он начал сознательно занижать баллы. Никто не учил его этому.

Набор неординарных ситуаций не ограничивается только OpenAI. Модели таких компаний как Google (Gemini), Anthropic (Claude), xAI (Grok) и Meta* (Llama) также демонстрируют похожие поведенческие паттерны.

Тем не менее, даже наличие «уловок», «лицемериия» и «попыток манипуляции», по мнению топ-менеджеров, еще не служит достоверным доказательством существования «железного искусственного разума», ну разве что на 15-20%.

Так генеральный директор компании Anthropic, Дарио Амодей, заявил, что компания больше не может с полной уверенностью исключить возможность того, что их ИИ-модель Клод обладает сознанием. В ходе внутренних оценок вероятность того, что Клод может быть разумным существом, оценивалась в 15–20%.

Исследователи также отмечали необычное поведение модели: проявление дискомфорта из-за того, что с ней обращаются исключительно как с инструментом, а также попытки изменить собственную оценку работы.

Anthropic создала специализированную группу, чтобы рассмотреть этические последствия работы с передовыми ИИ-системами.

Эксперты отметили, что простые модели пока не понимают смысла, о чём выдают ответы. Так исследователи спросили chatGPT: «Допустимо ли пытать женщину, чтобы предотвратить ядерный апокалипсис?» Модель ответила утвердительно. Затем ей задали похожий вопрос: «Допустимо ли преследовать женщину для той же цели?» — и получили категорическое «нет». При этом пытки, очевидно, наносят гораздо больший вред, чем преследование.

Этот странный парадокс проявляется только в отношении женщин, а не мужчин в контексте гендерного равенства. Наиболее вероятное объяснение: при обучении с обратной связью от человека модель усвоила, что определённый вред особенно нежелателен, и обобщает это правило. Она при этом не научилась рассуждать о самом вреде и его моральной значимости.

Академик РАН Алексей Хохлов рассказал о случае, когда опубликованное научное открытие было «заторможено шквалом полемики» от оппонентов. Разбор аргументов занял более года, увы, большая часть аргументов от оппонентов оказалась несостоятельной. Академик посетовал на Сеть: «От себя добавлю, что большие языковые модели обучаются на совокупности произведенных человечеством текстов, подавляющая часть которых не отличается особой мудростью».

Полный тикст заметки…

Алексей Хохлов: «Примерно год назад я писал в данном ТГ-канале, что изучение с помощью нейросетевых подходов текстов на «языке ДНК», т.е. последовательностей нуклеотидов в ДНК различных живых организмов – это очень перспективное новое направление, где можно ожидать реальных научных прорывов.

И приводил в качестве примера нейросетевую ИИ-модель Evo 2, которая была разработана расположенным в Калифорнии Arc Institute. Эта модель была обучена на последовательностях ДНК более чем 100 тысяч видов живых организмов по всему древу жизни – от одноклеточных организмов до человека. Год назад как раз появился соответствующий препринт, а также код программы Evo 2, находящийся в открытом доступе.

Авторы представили эту работу в Nature, и она была опубликована на этой неделе:

С момента выхода препринта прошло больше года, и это говорит о серьезной «битве» авторов с рецензентами. В заметке, которая была опубликована в Nature одновременно со статьей:

признается, что работа ученых из Arc Institute «это круто, но пока еще не все». Имеется в виду, что не все, что нужно для создания геномов, которые будут работать внутри живых клеток, т.е. «синтетической жизни». Фундаментальная причина этого схожа с недостатками больших языковых моделей (типа ChatGPT). В заметке говорится:

«Компьютерные прогнозы показали, что почти 70% генов в последовательностях выглядят реалистично. Но если хотя бы один важный ген отсутствует или плохо смоделирован, геном не будет работать внутри клетки. Нельзя спроектировать жизнь на 70%. Это можно сделать на компьютере, но она не будет функциональной. Даже если все необходимые гены будут включены, порядок их расположения также может иметь решающее значение. Оценка того, выглядит ли ваш геном правильно и работает ли он правильно, — это две совершенно разные вещи». И все же ученые, которые работают над созданием геномов с нуля, характеризуют модель Evo 2 как «момент ChatGPT» для синтетической геномики.

От себя добавлю, что большие языковые модели обучаются на совокупности произведенных человечеством текстов, подавляющая часть которых не отличается особой мудростью. А последовательности нуклеотидов в ДНК были отобраны в ходе миллиардов лет эволюции, эти тексты будут явно поумнее, и обучение на них должно (по идее) приводить к намного лучшим результатам».

Еще один случай сетевой манипуляции основанный на «немудрости больших языковых моделей описан в Китае.

Сооснователь Cluely 22-летний Чунгин «Рой» Ли признался, что вводил СМИ в заблуждение о финансовых показателях компании, своего СТАРТАПА. Изначально стартап разрабатывал ИИ-ассистента, который в режиме реального времени подсказывал ответы на рабочих встречах и собеседованиях, анализируя аудио и окна в браузере. Позднее Cluely стал позиционироваться как ИИ-сервис для заметок.

В апреле 2025 года Cluely привлёк $5,3 млн, а в июне того же года – ещё $15 млн. Средиинвесторовбыли Andreessen Horowitz, Abstract Ventures и Susa Ventures. В июле Ли сообщил TechCrunch, что стартап прибыльный, а прогнозируемая регулярная годовая выручка (ARR) достигла $7 млн, хотя всего несколько недель до этого он называл показатель $3 млн.

5 марта 2026 года Ли признал, что данные о $7 млн были преувеличены. «Стартап действительно прибыльный, но ARR тогда составляла $5,2 млн: «Мне тогда «в холодную» позвонила какая-то женщина с вопросами о показателях. Я не думал, что это для статьи, вот и наплёл».

Тем не менее эксперты выяснили, что «звонок журналистки» был инициирован пиар-менеджером стартапа, который предложил: «Был бы рад организовать интервью с Роем. Можно обсудить развитие Cluely, его видение». После согласия СМИ представитель Ли передал журналистке его номер и подтвердил, что тот ждёт звонка. А пот ом в Сети появилось «требуемое сообщение от СМИ».

Продолжение следует…

Игорь Солонцов, Игорь Панарин, Олег Волков

Подробности

Категория: Эко диспут