Anthropic научила Claude работать командой: теперь они спорят между собой и ищут баги вместе

Anthropic выкатила Agent Teams — фичу, где несколько Claude работают как команда. Они не просто параллельно трудятся, а реально общаются, спорят и опровергают теории друг друга. Для отладки и код-ревью — огонь. Но жрёт токены как не в себя.

Как я узнал про это

Короче, работаю я с AI-агентами (у нас их 44 штуки в проде), и основная боль — контекстное окно конечное. Даже с 200k токенов при анализе большого проекта упираешься в лимит быстро.

Варианты были:

Сжимать историю (теряешь детали)

Запускать subagents (они только отчитываются главному, между собой не общаются)

И тут Anthropic выкатила Agent Teams. Я сначала подумал: "Ну это просто параллельная работа, что тут нового?"

Облажался я знатно. Это не просто параллелизм. Это реальная коллаборация.

В чём прикол Agent Teams

Представь: ты запускаешь 5 экземпляров Claude, и они:

Работают независимо (каждый в своём контексте)

Общаются между собой напрямую (не через тебя)

Спорят, опровергают теории друг друга

Координируются через общий список задач

Пример из жизни:

Ты нашёл странный баг. Запускаешь 5 агентов с разными гипотезами:

Агент 1: "Может, WebSocket не держит соединение?"

Агент 2: "Проверил логи, WebSocket живой. Проблема в event loop."

Агент 3: "Нашёл! Unhandled promise rejection в message handler."

Агенты 4-5: "Попробовали воспроизвести — да, гипотеза #3 работает."

Результат: От 4 часов отладки до 1 часа. В 3 раза быстрее.

Побеждает теория, которая выживает после атак с 5 сторон. Это как научный спор, только быстрый.

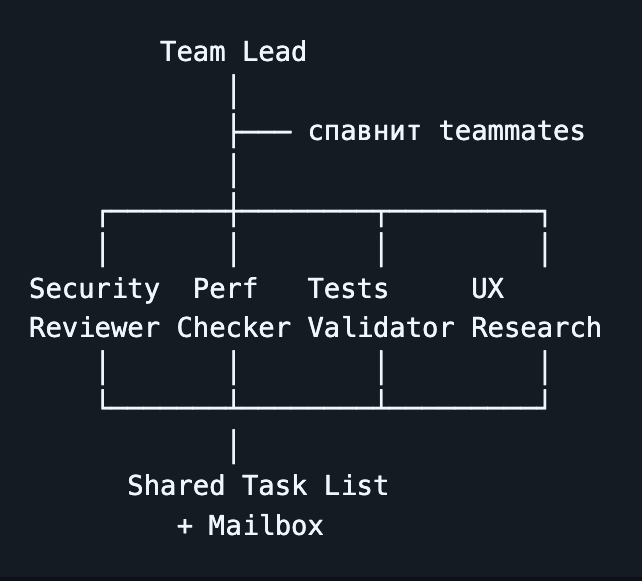

Архитектура (для тех, кому интересно)

Система состоит из:

Team Lead — главный агент

Создаёт команду

Раздаёт задачи

Синтезирует результаты

Teammates — члены команды

Отдельные экземпляры Claude

Свой контекст у каждого

Общаются через mailbox

Task List — общий список задач

С зависимостями (задача #2 не начнётся, пока не закончится #1)

Teammates сами берут задачи

Mailbox — система сообщений

Агенты пишут друг другу напрямую

Есть broadcast для всех

Схема (упрощённо):

Когда это реально полезно (проверено на себе)

1. Параллельный код-ревью

Проблема: Один ревьюер тяготеет к одному типу косяков. Смотрит на безопасность — пропускает проблемы с производительностью.

Решение: Запускаешь трёх ревьюеров одновременно:

Создай команду агентов для ревью PR #142. Запусти трех:

- Security Reviewer (SQL injection, XSS, auth)

- Performance Checker (N+1 queries, memory leaks)

- Test Validator (coverage, edge cases)

Что получается:

Было: 1 ревьюер → находит 70% проблем

Стало: 3 ревьюера → находят 95%+

Для финтеха или проектов, где баг стоит дорого — окупается на раз.

2. Отладка с конкурирующими гипотезами

Проблема: Один агент найдёт одно объяснение и остановится. Может быть неправильным.

Решение: Запускаешь 5 агентов, каждый с своей теорией. Они спорят и опровергают друг друга.

Реальный кейс:

Пользователи жалуются: приложение вылетает после одного сообщения. Запусти 5 агентов с разными гипотезами. Пусть спорят как учёные. Обновляй findings.md по мере консенсуса.

Агенты начинают дебаты:

"WebSocket проблема!" → "Нет, логи чистые."

"Event loop блокировка!" → "Проверил, нет."

"Unhandled promise rejection!" → "Да, воспроизвёл, это оно."

Результат: Быстрее к правильной причине. Теория выживает только если все остальные не смогли её опровергнуть.

3. Разработка новых модулей

Задача: Добавить систему уведомлений (Email, SMS, Push, Queue).

Решение:

Создай команду из 4 teammates:

- Teammate 1: Email (Resend API)

- Teammate 2: SMS (Twilio API)

- Teammate 3: Push (Firebase)

- Teammate 4: Queue (BullMQ)

Каждый владеет своей папкой в src/notifications/

Результат: Параллелизация в 4 раза. 2-3 часа вместо дня работы.

Важно: Разделяй файлы так, чтобы агенты не редактировали один и тот же. Иначе конфликты и перезаписи.

Как включить (если захочешь попробовать)

По умолчанию функция выключена. Включается через settings.json:

{

"env": {

"CLAUDE_CODE_EXPERIMENTAL_AGENT_TEAMS": "1"

}

}

Или через environment variable:

export CLAUDE_CODE_EXPERIMENTAL_AGENT_TEAMS=1

claude

После этого просто скажи Claude:

Создай команду агентов для [твоя задача]

Два режима отображения

1. In-process (по умолчанию): Все агенты в одном терминале. Shift+Up/Down для переключения.

2. Split panes (нужен tmux или iTerm2): Каждый агент в своей панели. Видишь всех одновременно.

Я использую in-process для быстрых задач, split panes — для долгих исследований.

Сколько это стоит (токены)

Суровая правда: Agent Teams жрут токены как не в себя.

1 агент на задачу = 50k токенов (~$0.15)

5 агентов = 250k+ токенов (~$0.75)

Но есть спасение: Если работаешь через Claude.ai с подпиской Claude Pro ($20/мес) — лимиты намного выше, чем через API. Для активного использования Agent Teams подписка реально окупается.

Когда окупается:

Code review для финтеха/security-critical (баг стоит дорого)

Отладка сложных багов (экономия времени х3)

Разработка модулей параллельно (быстрее в 3-5 раз)

Когда НЕ окупается:

Рутинные задачи

Малые проекты

Tight budget на API costs

Что НЕ работает / Где облажался

Честно говоря, функция экспериментальная. И косяков хватает:

Нет resume для in-process teammates: Перезапустил сессию — teammates пропали. Lead пытается им писать, но их уже нет. Приходится spawn новых.

Task status отстаёт: Teammate забывает пометить задачу как completed — блокирует другие задачи. Приходится вручную чинить.

Один тим на сессию: Нельзя запустить два тима одновременно. Cleanup → новый тим.

Split panes требуют tmux/iTerm2: В VS Code terminal не работает. Нужен внешний tmux.

Teammates иногда тупят: Застревают на ошибке вместо recovery. Приходится давать инструкции напрямую.

Lead завершается раньше времени: Решает, что всё готово, хотя задачи ещё не выполнены. Приходится говорить: "Жди teammates!"

Чем это отличается от subagents

У меня часто спрашивают: "А в чём разница с subagents?"

Subagents:

Отчитываются только главному агенту

Результат возвращается обратно

Дешевле (результат сжимается)

Для фокусных задач (поиск, анализ)

Agent Teams:

Общаются между собой напрямую

Ведут дебаты и координируются

Дороже (каждый = отдельный Claude)

Для сложной коллаборации

Простыми словами:

Subagents — для "найти и принеси"

Agent Teams — для "обсудите и придите к консенсусу"

Best practices (что работает у меня)

1. Давай агентам достаточно контекста

Teammates не видят историю lead. Они загружают только:

Твой CLAUDE.md

MCP серверы

Skills

Spawn prompt от lead

Плохо:

Spawn teammate для ревью аутентификации.

Хорошо:

Spawn teammate с промптом: "Провести security review модуля

в src/auth/. Фокус на token handling, session management,

input validation. Приложение использует JWT в httpOnly cookies.

Сообщи о проблемах с severity ratings."

2. Размеряй задачи правильно

Слишком мелкие → overhead координации > польза

Слишком крупные → агенты работают долго без check-ins

Правильные → самодостаточные юниты (функция, тест, ревью)

Совет: 5-6 задач на teammate. Если простаивают — попроси lead разбить работу мельче.

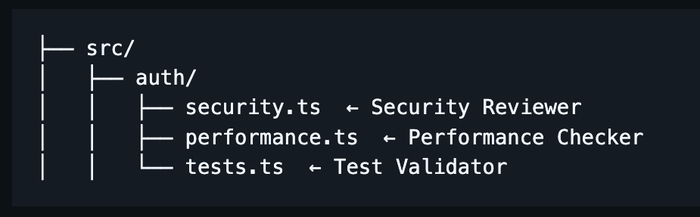

3. Избегай конфликтов файлов

Два агента редактируют один файл → перезаписи и потеря изменений.

Разделяй так:

4. Начинай с исследований

Если первый раз пробуешь agent teams — начни с задач без кода:

Review PR

Исследование библиотеки

Отладка без изменений

Так поймёшь механику без риска конфликтов.

Дисклеймер

Да, это звучит как реклама Anthropic. Но:

Функция бесплатная (в рамках API costs Claude)

Экспериментальная (косяков хватает)

Не для всех (жрёт токены)

Я просто делюсь тем, что реально использую. У нас 44 AI-агента в проде, и Agent Teams помогает в отладке и code review.

Не веришь? Попробуй сам. Включается одной строкой в settings.json.

Вердикт

Используй, если:

Code review критичен (финтех, security)

Отладка часто занимает дни

Разработка модулей может идти параллельно

НЕ используй, если:

Бюджет на токены ограничен

Проекты малые/средние

Задачи последовательные

Для простых задач — overkill. Для code review, отладки или исследований с разных углов — реально помогает.

Автор: Игорь Масленников

Канал: https://t.me/maslennikovigor

Прямой контакт: https://t.me/maslennikovig

GitHub (бесплатные инструменты для автоматизации разработки): https://github.com/maslennikov-ig/claude-code-orchestrator-kit

Если попробуешь Agent Teams — напиши что получилось. Интересно услышать опыт других.

Знаю, минусы прилетят за "реклама Anthropic". Но я честно рассказал и про косяки тоже. Функция сырая, но для определённых кейсов работает.