Авторская техническая библиотека

Привет всем!

Сегодня я хочу представить вам проект, который многие с порога назовут безумием. И это прекрасно!!!

Знакомьтесь: Авторская техническая библиотека .

Это обширный и динамично развивающийся ресурс, всецело посвящённый новым идеям и экспериментальным разработкам в различных областях науки и техники, метафизике, литературе и т.п.

Коллекция библиотеки отличается исключительным разнообразием, охватывая широкий спектр материалов: от глубоких теоретических исследований, предлагающих фундаментальное понимание сложных явлений, до инновационных практических решений, готовых к применению в различных отраслях в различных областях науки и техники. Каждый раздел дополнен наглядными иллюстрациями, включая детальные фотографии и видеоматериалы, что позволяет максимально полно погрузиться в суть представленных работ.

Здесь вы найдёте новые взгляды на актуальные научные проблемы, которые ставят под сомнение устоявшиеся парадигмы и открывают двери для прорывных открытий.

Библиотека предоставляет уникальную возможность для свободного доступа к новым знаниям, способствуя обмену идеями и развитию инноваций.

Или обязательно минусуйте рейтинг публикации, что самое важное здесь!!!

Продолжение поста «Посоветуйте ИИ для анализа локальной библиотеки (книги\чертежи)»2

Продолжаю свой же пост.

За это время было подготовлено около 40 Гб материалов, в формате PDF (текст+картинки+чертежи+схемы) только на русском языке.

Также, за это время, был подготовлен компьютер, следующей конфигурации:

х2 Intel Xeon E5 2680 v4

128 Gb RAM DDR4 3200Mhz

x2 nVIDIA TESLA P40, 24Gb vRAM DDR5

m2 Samsung EVO 1Tb

На компьютер установлен Linux Debian

Теперь дело за выбором, собственно, нейронки, которая будет тут работать.

Изучаю семейство моделей Cerebras-GPT.

Из плюсов:

- уже обучены

- могут работать без доступа к интернету

- сдержанны в потреблению ресурсов

Прошу высказывать мнения.

Заранее всем благодарен заранее всем благодарен :-)

Ответ на пост «Посоветуйте ИИ для анализа локальной библиотеки (книги\чертежи)»2

Ваш вопрос сродни вопросу на форуме про БАДы как вырезать себе аппендицит.

Ну или не себе, а другу. Не суть.

Если вы задаётесь таим базовым вопросом, да ещё и тут на пикабу, то ответ вам не поможет. Если бы помог, то вы бы тут этот вопрос не задавали.

Однако должен же кто-то в комментах написать выглядящий релевантным (но по-прежнему бесполезный) ответ...

Суть задачи. Есть гигантская цифровая библиотека из слабо формализованных или вовсе не формализованых данных по некоторой предметной области. Речь о петабайтах.

Исходим из того, что там в основном PDF и графика, возможно видеозаписи лекций, обзоров, и хрен пойми ещё чего (иначе мне трудно объяснить такие гигантские объёмы).

Необходимо создать интеллектуальную экспертную систему, которая могла бы отвечать на вопросы по предметной области ссылаясь на конкретные материалы.

Короче. Ваш проект имеет смысл, но выбирать и фиксировать под него одну какую-то единственную конкретную нейронку - это очень странная затея. Технологии в этой отрасли каждый день приносят что-то новое, а то, что вы внедрите после пары лет разработки уже год как будет просто в хлам устаревшим. Это при условии, что через два года вы внедрите не то, что актуально вот прямо сейчас. То. что актуально сейчас, уже, считай, устарело.

Да, такие вот издержки околосингулярных нынешних этапов развития цивилизации и технологий.

Но не будем отвлекаться.

Если бы мне кто-то поставил задачу начать такой большой проект (да, именно начать, потому что в ходе разработки там дофига всего вылезет и дофига инструментов будет написано).

Короче, я бы не фокусировался на конкретную нейронку. Я бы делал слоистую архитектуру и настраивал пайплайн по переработке (а фактически индексированию) данных.

Очевидно, что в у пайплайна будет ряд задач:

- структуризация и формализация структуры входных исходных данных.

- разбор (парсинг файлов разных форматов), нарезка на смысловые блоки и формирование связных ссылок между блоками. В результате получим граф блоков с базовой структурой ссылок между ними.

- отдельная часть пайплайна будет детектировать и классифицировать блоки, разбивать их на более детальные (например, формулы, диаграммы, графики).

- отдельная часть пайплайна делает разметку блоков назначая теги, которые будут указывать тип контента, язык, ну и ещё "миллион" других параметров и атрибутов контекста.

- отдельная часть пайплайна будет осуществлять OCR (нет, это не обсессивно компульсивное расстройство).

- отдельный механизм будет отвечать за хранение и кэширование информации о чанках этих данных.

- далее нам надо сделать векторизацию для поиска релевантных кусков данных.

- ну и целый гигантский кусок пайплайна будет отвечать за некоторое подобие RAG.

Надо понимать, что разные данные с разной эффективностью индексируются разными моделями. Заранее вам никто не скажет какая модель и какая нейронка покажет себя лучше. Может быть для чего-то придётся обучать или дообучать свою модель.

Нужно быть готовым к тому, что придётся заменять Эмбеддеры на ходу, держать несколько параллельных индексов. Это значит, что не получится сперва всё написать, а потом одним махом обработать пайплайном весь айсберг имеющихся данных. Вы то и дело будете налетать на ошибки и проблемы, связанные с возрастанием сложности и объёма данных. Будут выходить новые инструменты, механизмы, модели. Ваше решение должно уметь встраивать на абстрактных уровнях новые инструменты, заменять какие-то слои.

При этом должна быть реализована внутренняя система зависимостей. Если вы замените эмбеддер для индексации формул, то не нужно парсить и переиндексировать вообще весь объём данных. У вас уже есть БД с чанками формул, есть окрестный контекст для каждой формулы, вам нужно подать в эмбеддер только нужное.

Возможно понадобится делать какие-то промежуточные слои данных резюмирующие главы и блоки информации из книг, нормативных справочников и документов. При изменении пайплайна необходимо переобрабатывать только те куски данных, которые затронули сделанные изменения пайплайна, иначе ваш проект будет перезапускаться при каждой правке, и вы никогда не завершите работу.

Очевидно, что вся ваша глыба данных имеет какую-то гранулярность внутри, и её части имеют разную "калорийность", то есть ценность для тех инференсов, которые вы хотите по этим данным делать. Это значит. что не лишено смысла сделать ранжирование материалов на каком-то уровне иерархии структуры вашей библиотеки. Возможно это ранжирование будет пересматриваться со временем, и по мере роста компетенции формирующейся экспертной системы она сама сможет влиять на это ранжирование для более эффективной обработки всего объёма библиотеки.

Короткий ответ: нет какого-то единого инструмента или модели для вашей задачи. Вам придётся интегрировать огромный букет технологий, инструментов, моделей и решений для вашей большой задачи, и долго итеративно настраивать всю это машинерию под вашу специфику. Об универсальных готовых решениях я не слышал, но, возможно при обучении больших генеративных моделей какие-то из перечисленных кусков пайплайна уже где-то реализованы в виде более-менее юзабельных инструментов. Также нужно быть готовым к замене отдельных частей всего этого пайплайна: от эмбеддеров и языковых моделей, то целых кусков конвейеров автоматизации обработки данных. То, что на первый взгляд и на первых этапах кажется достаточным, потом может оказаться дешевым и простым способом улучшить качество за счет переработки или замены этого узла.

Думаю вам следовало бы провести базовую декомпозицию это йогромной задачи, а потом спрашивать уже про инструменты для базовых решений в рамках MVP по конкретным слоям и узлам. К примеру, вы можете использовать N8N для визуального представления потоков данных и узлов пайплайна, но конкретные модели и эмбеддеры можно будет заменять в ходе разработки, или дублировать применяя несколько параллельных подходов, а потом выбирать динамически лучшие результаты.

Оговорюсь, что я не специалист в этой теме, и тоже с удовольствием бы увидел ссылки на какие-то готовые попытки решать такие задачи. Просто хотел немного прояснить ситуацию. так, для эрудиции и общего развития.

Текст написан исключительно естественным интеллектом без использования искусственных нейронных сетей.

Посоветуйте ИИ для анализа локальной библиотеки (книги\чертежи)2

Приветствую всех

Есть небольшое производство зап.частей для китайской роботизированной агро-техники.

Есть огромная (что-то около 10-12 петабайт) библиотека материалов на нескольких европейских языках (текст с картинками, чертежи\схемы, таблицы) по данной сфере. Библиотека регулярно пополняется.

Есть бюджет в несколько кк\рублей.

Надо: поставить локильный сервак и поселить на нём нейронку, которая сможет анализировать всю эту библиотеку и, по-запросу (текстом\голосом) выдавать развёрнутые ответы с приведением соответствующих материалов из библиотеки. Все запросы и ответы будут на русском языке. То есть, в случае необходимости, нейронка должна уметь в перевод с технических диалектов (жаргонов) нескольких языков.

Важный аспект: всё это в офф-лайне. И сама библиотека, и будущий сервак с нейронкой.

Прошу посоветовать модели нейронок, подходящих для данной задачи. Или накидать ссылок: где почитать об этом.

UPD:

1. Модели, разработанные компанией МЕТА (запрещена в РФ), а также продукты компании Open AI, не допускаются для применения.

2. Рассматривается семейство моделей Claude

3. Бюджет, для решения данной задачи, несколько миллиардов рублей. Так что вопрос о техническом обеспечении, можно решить на довольно высоком уровне.

4. Так называемые "сырые" данные, обрабатываются людьми. Вручную. Нейронка будет работать с теми данными, которые прошли через людей. Поэтому и объёмы для обработки, будут нарастать постепенно, и каждый вновь поступающий объём, будет, условно, посвящён одной теме. Нейронке нужно будет просто присовокупить новый объём, к массиву уже обработанных ею данных.

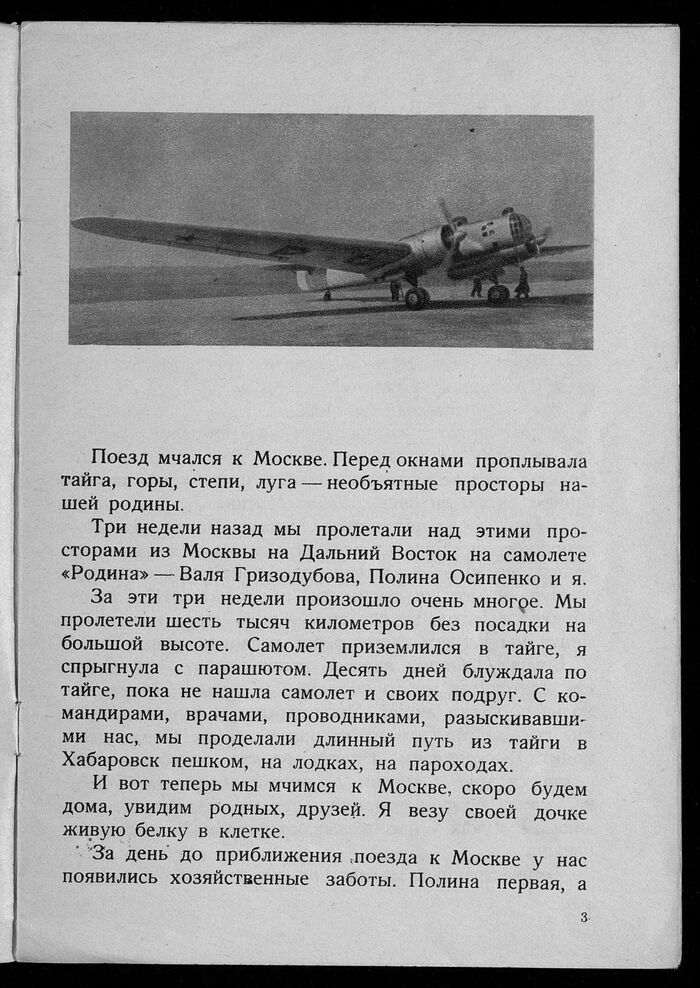

15.01.2001 — Рождение Википедии [вехи_истории]

📚 Джимми Уэйлс и Ларри Сэнгер запустили Википедию как «экспериментальную» вики-версию энциклопедии Nupedia.

📈 К концу 2001-го она собрала 18 тысяч статей и доказала: любой человек может редактировать знания.

🧠 Сегодня Википедия — 6 миллионов статей на английском, 20 миллионов страниц суммарно и главный источник информации для ИИ-моделей вроде ChatGPT.

![🗓 15.01.2001 — Рождение Википедии [вехи_истории]](https://cs19.pikabu.ru/s/2026/01/13/06/ehfuxyiz.jpg)